Transformer

4/17/26Less than 1 minute

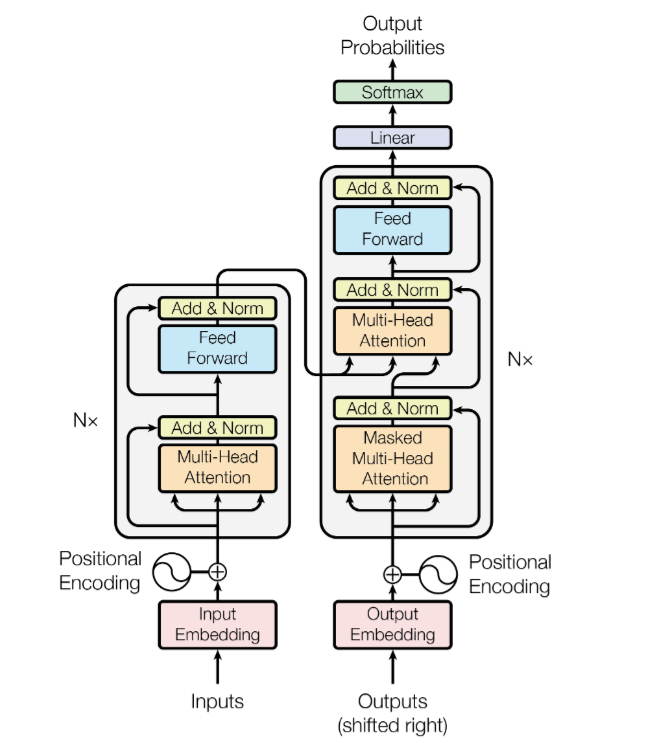

Transformer

编码器

Transformer 的编码器用于理解输入序列的语义信息,并生成每个token的上下文表示,为解码器生成目标序列提供基础。

编码器由多个结构相同的编码器层(Encoder Layer)堆叠而成。

- 位置编码:Transformer 无法像 RNN 那样天然地捕捉词语之间的顺序关系,位置编码为每个词引入一个表示其位置信息的向量,并将其与对应的词向量相加

- 自注意层:Self-Attention

- 前馈神经网络层:MLP

- 残差连接与归一化

解码器

Transformer 解码器的主要功能是根据编码器的输出,逐步生成目标序列中的每一个词(Masked 自注意力子层提供并行方式)

解码器也由多个结构相同的解码器层堆叠组成

- Masked 自注意力子层:Causal Attention

- 编码器-解码器注意力子层:

- Query 来自 解码器 当前的输入表示,即当前生成状态

- Key 和 Value 来自 编码器 的输出表示,即整个源序列的上下文